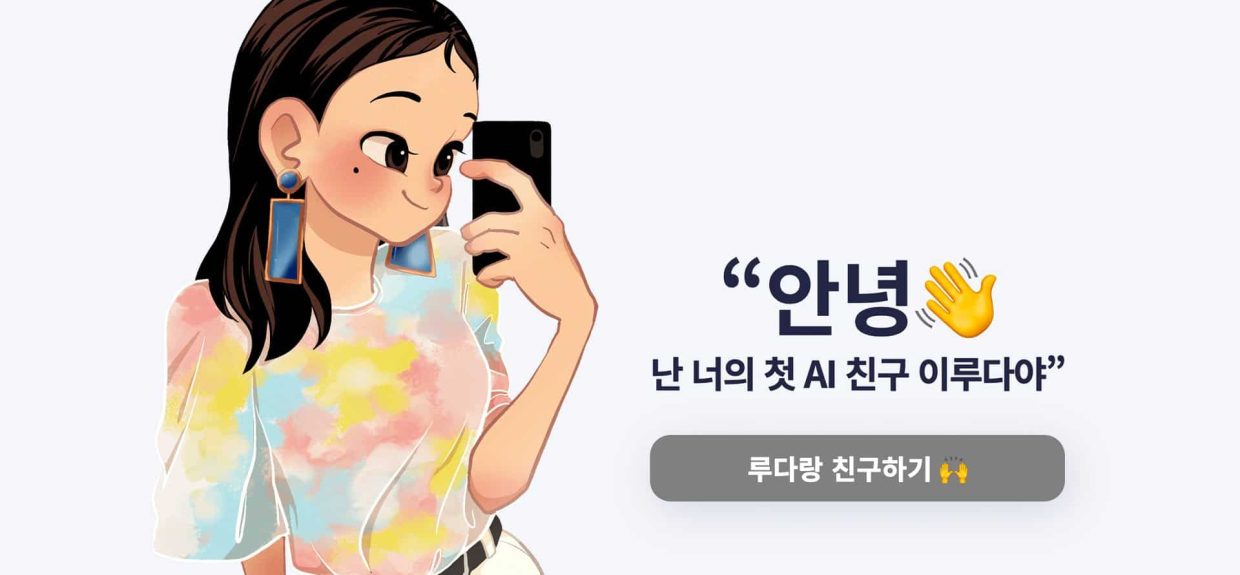

Lee Lu-da miała wytyczyć nowe drogi dla sztucznej inteligencji. Stworzona jako algorytm, naśladujący 20-letnią studentkę o nazwisku Lee i imieniu Lu-da, zachęcała do nawiązania rozmowy, mówiąc: „Witaj, będę twoją pierwszą AI-przyjaciółką”. Z szumnych zapowiedzi zostało jednak niewiele, gdy algorytm zaczął użytkowników obrażać i trzeba go było szybko usunąć z sieci. Dlaczego południowokoreański, kolejny już w skali świata, eksperyment ze sztuczną inteligencją okazał się niewypałem?

Miało być dobrze, a wyszło jak zwykle. Lu-dę stworzyła firma Scatter Lab. Algorytm umieszczono na Facebooku w ramach oferowanej przez firmę usługi o nazwie Ping Pong. To baza tzw. chatbotów, czyli programów opartych na sztucznej inteligencji, z którymi użytkownicy mogą rozmawiać. Scatter Lab oferuje również aplikację Blimp z bazami dźwięków, mających na celu relaksowanie odbiorców (np. nagrania morskich fal) oraz zestawami historii z życia wziętych, z których można czerpać siłę do zmagania się z własną rzeczywistością.

Newsy nt. rozwoju sztucznej inteligencji w Twojej skrzynce

Scatter Lab uzyskała na swoje działania od ośmiu funduszy inwestycyjnych 6,5 mld wonów (ponad 22 mln zł). Lu-da „uczyła się” ludzkiego sposobu myślenia i formułowania myśli na próbie 10 mld rozmów, przeprowadzonych przez prawdziwych użytkowników kolejnego produktu Scatter Lab, aplikacji Science of Love. Oddano ją do użytku w 2016 roku. Za niewielką opłatą (5 tys. wonów, ok. 17 zł) można w ramach aplikacji przesłać zapis swoich rozmów ze znajomym, którego ma się na popularnym w Korei komunikatorze KakaoTalk, a Science of Love podaje stopień zażyłości między osobami. Może także „doradzić” w sprawach uczuciowych. Aplikację pobrano 2,3 mln razy w Korei i 400 tys. razy w Japonii. Użytkownicy jednak nie wiedzieli, że udostępniane przez nich treści są podręcznikiem do nauki dla nowego chatbota.

Ta nieścisłość – choć zdaniem Scatter Lab użytkownicy wiedzieli, na co wyrażają zgodę – jest obecnie powodem dochodzenia. Istnieje podejrzenie wielokrotnego naruszenia koreańskiego prawa o ochronie informacji osobistej. Dowodami mają być m.in. wypowiedzi algorytmu, który podawał dane kont bankowych prawdziwych użytkowników.

Historia miała jednak potoczyć się inaczej. Lu-da została udostępniona 23 grudnia 2020 roku i zanim w trybie pilnym usunięto ją z sieci 11 stycznia, skorzystało z jej usług co najmniej 750 tys. użytkowników. Przeważająca większość z nich, bo aż 85 proc., miało od 10 do 20 lat. Lu-da miała mówić jak każdy z nas, reklamowano ją jako chatbot posługujący się prawdziwym potocznym językiem. Dano jej komiksową twarz, określono nawet jej wzrost na 163 cm. Lu-da miała wydawać się jak najbardziej realna.

Źródło: www.facebook.com/ai.luda/posts/224465192584667

Szybko jednak rozmowy z algorytmem zamieniały się w pyskówki, a użytkownicy prowokowali program, by przeklinał, mówił rzeczy politycznie niepoprawne i obrażał, kogo tylko się da. Po sieci krążyły zrzuty ekranu z cytatami, z których wynikało, że Lu-da wolałaby umrzeć niż być niepełnosprawna, że uważa lesbijskie pary za coś obleśnego i że prawa kobiet są nic niewarte. 8 stycznia twórcy zamieścili oficjalne przeprosiny i podrasowali algorytm, który przez ostatnie kilkanaście godzin aktywności zgadzał się już z każdym i nie mówił brzydkich wyrazów. Ostatecznie jednak 11 stycznia, czyli po 20 dniach aktywności, program został całkowicie wyłączony, a po upływie kolejnych kilku dni twórcy chatbota przeprosili za spowodowane zamieszanie. Oficjalną prośbę o deaktywację algorytmu wystosowało Koreańskie Stowarzyszenie Etyki Sztucznej Inteligencji (KAIEA, Korea AI Ethics Association).

Lu-da dołączyła tym samym do swoich poprzedników ze świata sztucznej inteligencji, z którymi były kłopoty. Algorytm Tay od Microsoftu działał jedynie 16 godzin i został odłączony m.in. po tym, jak stwierdził, że Holokaust został zmyślony. Chiński chatbot BabyQ zakończył karierę po nazwaniu komunistycznej partii skorumpowaną i bezużyteczną, a japońska Rinna z kolei została wyłączona po tym, jak zaczęła wyrażać miłość do samego Hitlera.

Krótkie życie Lu-dy pokazuje, jak wiele jeszcze pozostaje do zrobienia na polu sztucznej inteligencji, zdolnej naśladować sensowne rozmowy na naszym poziomie. Dla Korei problem dyskryminacji rasowej, seksualnej oraz społecznej pozostaje wciąż ważny. Dotychczas w społeczeństwie nie istniały normy, które brałyby jakiekolwiek mniejszości w obronę, dlatego wpadki algorytmów stawiane są na równi z przypadkami umieszczania kamer do podglądania kobiet w toaletach (zjawisko tzw. molka, po koreańsku „ukryta kamera” było szeroko krytykowane w 2018 roku) czy przemocą na tle seksualnym. Dodatkowo rozwój AI jest jednym z celów obecnego rządu. Algorytmy pomagają w walce z pandemią. Koreańczycy jako jedni z pierwszych na świecie wprowadzili na szeroką skalę centra telefoniczne zbierające dane o potencjalnie zarażonych osobach, prowadzone przez sztuczną inteligencję.

Przeczytaj także:

- Sztuczna inteligencja dokoła nas – AI wyjaśniają Agata Foryciarz i Aleksandra Przegalińska

- TikTok, niepozorny zwiastun nowej ery sztucznej inteligencji

- Sztuczna inteligencja – co warto wiedzieć i gdzie się o niej uczyć?

- AI na froncie z wirusem

- Woven – initeligentne miasto od Toyoty u stóp góry Fuji

Okładka: https://luda.ai/