Jeszcze niedawno „prompt engineering” miał być umiejętnością (i zawodem) kluczowym na czas rewolucji AI. Ledwie trzy lata od premiery ChatGPT, narzędzia generatywnej sztucznej inteligencji, tworzone są tak, jakby domyślały się naszych intencji. Dodatkowo są w stanie same podpowiadać nam, jak najlepiej się z nimi komunikować.

Ewolucja inżynierii promptów

Ewolucja wielkich modeli językowych (LLM) zmienia charakter interakcji z narzędziami AI. Najpierw dość szybko przeszliśmy od prostego „zadawania pytań” do „programowania językiem naturalnym”. Osiąganie dłuższych, lepszych czy bardziej poprawnych wyników wymagało znajomości tego, na jaką konstrukcję instrukcji i słowa dany model reagował lepiej. Następnie konieczne było dopasowywanie promptów do tych często nieprecyzyjnych i płynnych zasad.

Optymalizacja instrukcji oznaczała czasem pisanie i testowanie wielu wersji instrukcji, eksperymentowanie z językiem. W przypadku zaawansowanego korzystania z modeli AI nieodzowne było również modyfikowanie parametrów modeli, np. takich jak temperatura, która odpowiada za większą lub mniejszą losowość podczas generowania odpowiedzi (co w wielu przypadkach porównuje się do manipulowania „kreatywnością” odpowiedzi).

Od idealnie napisanej instrukcji, w której konkretne zwroty i ich kolejność mają sterować jakością odpowiedzi, dziś ważniejsza jest świadomość, z jakiego narzędzia korzystamy. To wpływa na to, jakie funkcje możemy w nim włączyć na poziomie interfejsu lub za pomocą zwrotów, które je włączają. Weźmy dla przykładu ChatGPT, w którym mamy dostępne funkcje głębokiego rozumowania czy wyszukiwania w sieci. Poza przyciskami w interfejsie funkcje te włączają się również, kiedy sprowokujemy model prostymi frazami, jak „pomyśl głęboko nad tym” czy „wyszukaj w sieci źródła”. A to wszystko dlatego, że ChatGPT w najnowszej wersji ma narzędzie (tzw. router), które decyduje, jaki konkretny model i funkcje uruchomić na bazie naszej instrukcji. Takie bezpośrednie frazy odnoszą się właśnie do tego procesu.

Prompt a kontekst

Zgodnie z nazwą, modele językowe są wrażliwe na język instrukcji, ponieważ to na danych językowych były trenowane. Są również narzędziami generatywnymi, które nawet dla dokładnie tej samej instrukcji zadanej przez dwie różne osoby, składają osobne odpowiedzi. Dlatego nawet „najlepszy” prompt nie gwarantuje zawsze „najlepszego” i przewidywalnego wyniku.

Wraz z pojawieniem się modeli, które dokonują podziału naszych instrukcji na zadania i mogą wykonywać je krok po kroku (tzw. modele głębokiego rozumowania), skomplikowane instrukcje przestały dawać aż tak dużą przewagę, jeśli chodzi o jakość i powtarzalność wyników. Nie oznacza to, że straciły zupełnie sens.

Aby w pełni wykorzystać potencjał narzędzi AI w środowisku profesjonalnym, konieczne jest zrozumienie różnicy między nimi i podstawowych zasad dwóch procesów:

- tworzenia instrukcji (prompt engineering)

- i zarządzania tym, co model weźmie pod uwagę podczas generowania odpowiedzi (context engineering).

Prompt Engineering to proces iteracyjnego projektowania instrukcji (danych wejściowych) tak, aby uzyskać wynik, jak najbardziej zbliżony do naszych oczekiwań (np. precyzji, jakości, długości etc.). Taki proces „wymuszania” na modelu konkretnych odpowiedzi może obejmować dawanie przykładów (ang. few shot), opisywanie procesu wnioskowania (chain of thought), opisywanie ograniczeń i formatu odpowiedzi.

Technicznie brzmiący Context Engineering to po prostu zarządzanie informacjami, które są dostarczane modelowi w ramach jego okna kontekstowego (to, co model ma w pamięci operacyjnej w danej sesji). Kontekst możemy przekazywać zarówno w instrukcji, jak i w dodatkowych materiałach załączanych modelom do pracy np. załączniki w ChatGPT czy Gemini. Zarządzanie kontekstem to m.in. selekcja informacji i tzw. grounding, czyli zapewnianie modelom AI dokładnych, aktualnych i konkretnych informacjach (np. dokumentacja), zamiast polegania na wiedzy, na której były wytrenowane.

Ręczna optymalizacja promptów

Choć może wyglądać to banalnie i zaskakująco, to podstawowym narzędziem do poprawiania naszych instrukcji dla AI, są dokładnie te same narzędzia AI. Być może już próbowałeś/aś prostego triku, jakim jest danie ChatGPT, Gemini lub innemu chatbotowi, zadania napisania dla Ciebie lepszego promptu.

To bardzo prosty sposób na optymalizację naszych instrukcji, ponieważ modele te piszą w bardziej ustrukturyzowany sposób niż ludzie (w ten sposób porządkują instrukcje dla samych siebie) oraz często mają dostęp do dokumentacji własnego działania (mogą zastosować porady, których my nie znamy).

Weź prompt, który wykorzystujesz w narzędziach AI i wypróbuj prompt optymalizacyjny poniżej:

Jesteś ekspertem w dziedzinie tworzenia promptów, specjalizującym się w tworzeniu podpowiedzi dla modeli języka sztucznej inteligencji, w szczególności modelu [Wpisz model, którego używasz np. ChatGPT 5.1]

Twoim zadaniem jest przekształcenie mojego promptu w dobrze skonstruowany i skuteczny prompt, który wywoła optymalne odpowiedzi od modelu.Sformatuj prompt jako blok kodu, aby był przejrzysty i łatwy do skopiowania.

## Oto mój początkowy prompt:

[WKLEJ PROMPT]

Ta strategia sprawdzi się z większością narzędzi AI i można łatwo dopasować ją do tego, z jakiego modelu korzystasz. ChatGPT i Gemini, zwłaszcza jeśli do kontekstu dodasz dokumentację innych narzędzi, mogą pomóc w pisaniu promptów do generowania wideo i grafik. Takie informacje dla popularnych modeli znajdziesz tutaj:

Automatyczne narzędzia optymalizacji promptów

Dla ChatGPT dostępne jest narzędzie, które optymalizację promptów przenosi na kolejny, wyższy poziom. Przy okazji premiery modelu GPT-5 udostępniono prompt optimizer, który nie tylko doskonali nasze instrukcje, ale również udziela informacji zwrotnej dot. wprowadzonych zmian.

Narzędzie działa bardzo prosto. Wklejamy prompt, a po kliknięciu „optymalizuj”, przekształca podane polecenie w uporządkowaną instrukcję. Optymalizator uwzględnia automatycznie dokumentację i najlepsze praktyki dla jednego z wybranych modeli (GPT-5, 5.1, 4 i lub o3).

Z pomocą okienka czatu przed przyciskiem Optimize możemy również opisać cel naszej instrukcji (np. dokładność, zwięzłość), albo efekty, które chcemy zmienić w działaniu danej instrukcji (np. błędy otrzymywane do tej pory).

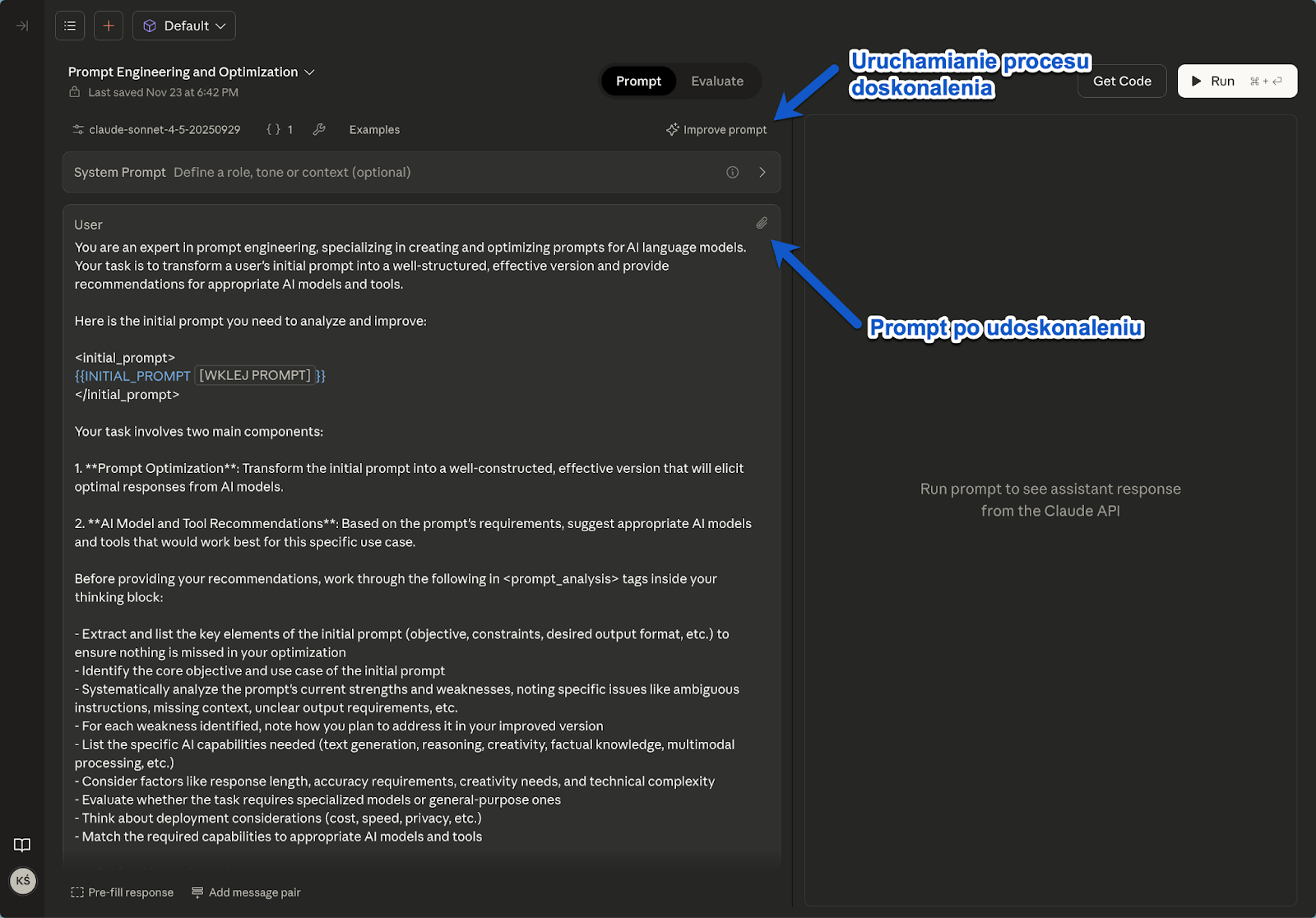

Claude również oferuje narzędzie o podobnych, choć bardziej zaawansowanych możliwościach, o nazwie Prompt Improver, ale wymaga ono zakupu kredytów na koncie dla deweloperów. Narzędzie dla modeli Claude pozwala określić i doskonalić zarówno system prompt (główne instrukcje dla modelu) oraz user prompt (konkretne zapytanie) i dokonuje kilkustopniowych poprawek. Nie otrzymamy tutaj informacji zwrotnej od narzędzia ChatGPT, ale mamy za to więcej narzędzi do testowania i rozwijania promptów do budowy narzędzi i chatbotów. To narzędzie, które spodoba się deweloperom i deweloperkom.

Google oferuje podobne, choć bardziej zaawansowane narzędzie na platformie dla Vertex, ale wyłącznie dla osób korzystających z konta dla deweloperów i posiadające klucze API dla modeli Gemini.

Podsumowanie

Narzędzia AI mają sens, kiedy rozumiemy ich działanie i możemy samodzielnie i efektywnie korzystać z nich do pomagania sobie w pracy. Śledzenie trendów w promptowaniu oraz pobieranie kolejnych pakietów „100 najlepszych promptów dla X” od influencerów to dodatkowa (i często zbędna) praca. Optymalizacja promptów to jeden z tych sposobów usprawniania sobie pracy z AI, który sprawdzi się zarówno osobom poszukującym praktycznych usprawnień, jak i tym bardziej zaawansowany, które budują własne narzędzia AI.

Przeczytaj także: